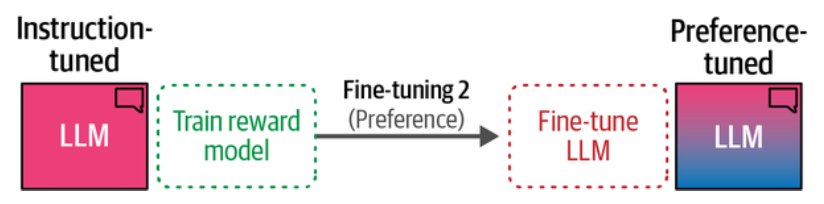

这应该是阅读本书的最后一篇笔记了,下一本书的目标是《Build a Large Language Model (From Scratch)》。大模型的三步走,预训练、微调、和偏好调优。 本篇的来了解最后一步偏好调优, 对齐(Preference-Tuning / Alignment RLHF), RLHF 是一个像那些 RoPE, LoRA, MoE, SFT 等经常见得着但不知道意义的高级词。 RLHF(Reinforcement Learning from Human Feedback): 用人类的偏好判断来训练一个"打分模型",再用强化学习让语言模型朝高分方向优化。

模型经过指令微调后更听话了,我们还要最后的训练来进一步改进其行为,使用与我们期望它在不同场景中的表现保持一致。做法就是让一个偏好评估者(人或其他方式) 评估模型生成内容的质量

- 如果分数较高,更新模型,以鼓励它产生更多这类生成内容

- 如果分数较低,更新模型,以抑制它产生这类内容

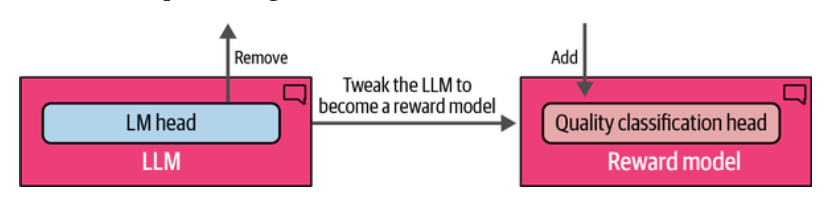

我们可以训练一个叫作奖励模型(reward model) 的模型来实现偏好评估自动化,是要在偏好调优步骤之前增加一个步骤,即训练一个奖励模型

经过指令微调的模型,去掉建模头(LM Head), 加上质量分类头(Quality classification head), 让该分类头只输入单一的分数。如果观察前一篇微调出来的模型

Read MoreTinyLlama-1.1B-sft它最后有一个lm_head层。

终于来到最后一章了,要学习是如何微调生成模型,生成模型才是天天所面对的模型,嵌入模型只在需要 RAG 或者模型记忆的时候才会用到,而用表示模型进行分类的场景还是极少。 对于私有数据资料应该用 RAG 还是微调生成模型呢?到目前为止自己也拿不准,因为还只会 RAG, 学完了本章会有一个更感性的认识。 相较于微调表示模型, 微调生成模型后可以进行更直接的交互用以验证微调的效果。在本章会接触到不少炫目的名词,如 SFT, RLHF, PEFT, LoRA, QLoRA, DPO 等。

微调生成模型有两种最常见的方法: 监督微调(Supervised fine-tuning) 和偏好调优(preference tuning)

LLM 训练三阶段: 预训练,监督微调,偏好调优

语言建模(Language Modeling)

或称预训练(Pre-training)阶段,简称 PT, 使用海量无标注文本数据进行预训练,这一阶段是最贵的,一般公司是玩不起的。它的目标是学习语言的统计规律, 预测下一个词是什么,或者给定上下文预测缺失的词是什么。预训练阶段的模型被称为基座(Base)模型,通常也称为预训练(Pretrained)模型或基础(Foundation)模型。

比如模型在输入 "法国的首都是" 后,预测下一个词是 "巴黎"。它还听不懂指令,不回答问题,比如对于输入 "解释黑洞是什么?", 基础模型只会续写,比如

输入:

Read More把'苹果'翻译成英文基础模型续写:把"苹果"翻译成英文:苹果的英文是apple,另外橙子是orange,香蕉是banana……

一鼓作气,继续阅读本书,来到了第十一章,本章的标题是 “为分类任务微调表示模型”,而嵌入模型也是表示模型的一种,前一章有学过如何训练和微调嵌入模型。 第 4 章中学习了使用预训练模型进行文本分类,本章将要学习对 BERT 模型的多种微调方法,以适应分类任务。还是文本分类,下一章也就是原书的最后一章才会讲到微调生成模型, 这才是本人更加期待的内容,还是按顺序来消化吧。

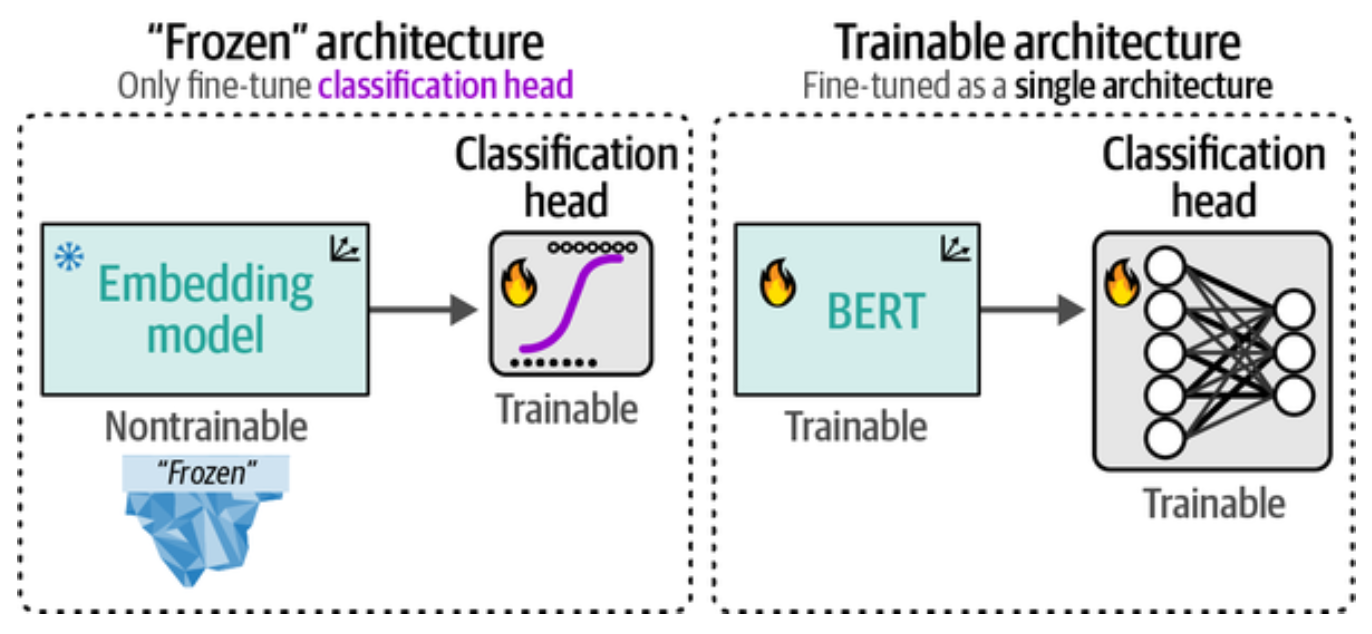

在第 4 章处理监督分类时采用过两类模型:特定任务模型(如情感分析)和用于生成文本嵌入表示的嵌入模型。在微调时是否要冻结一部分参数可分为参数高效微调与全量微调

Read More

Read More

第三部分: 训练和微调语言模型 - 微调嵌入模型

仍然是第 10 章的部分,会学习到微调嵌入模型,监督学习(Supervised Learning)和无监督学习(Unsupervised Learning)的内容。 前面学习的其实也是在一个基础模型的基础上创建一个嵌入模型。

本书把以

bert-base-uncased作为基础模型创建嵌入模型叫做从头开始训练嵌入模型,有点不理解。bert-base-uncased本身就是一个预训练的基础模型, 它的训练语料是 BookCorpus + English Wikipedia, 共约 33 亿词。而所谓的微调嵌入模型就是把bert-base-uncased换为另一个预训练的 sentence-transformers 模型。这与前面的训练过程又有何区别呢?因为

bert-base-uncased就可以直接用来对句子生成嵌入向量,比如下面的代码可得到句子的嵌入向量1from sentence_transformers import SentenceTransformer 2 3model = SentenceTransformer('bert-base-uncased', device="cuda") 4embeddings = model.encode(["The weather is nice today"])所以本章的微调嵌入模型时所谓的监督学习不过是把前面的基本模型换成了另一个专门用对比学习预训练过的

Read Moreall-MiniLM-L6-v2模型,其他代码完全就没变。 选基础模型的时候还得了解它是怎么训练的,训练语料是什么样的,训练目标是什么样的,这样才能知道它适不适合用来微调嵌入模型。

第三部分: 训练和微调语言模型 - 构建文本嵌入模型

终于来到了可以真正实战的部分,前面的章节都是关于理解和使用大语言模型的知识,现在可以开始动手实践了。涉及到训练和微调模型, 不过本书只讲了如何训练一个嵌入模型,要学习训练一个生成模型的知识还得看 Build a Large Language Model (From Scratch) 这本书,或者参考 Karpathy 的 nanoGPT 项目。

先从构建一个文本嵌入模型开始吧。嵌入模型是 NLP 的基础,它可应用于多种场景, 如监督分类(supervised classification), 无监督分类(unsupervised classification), 语义搜索等, 甚至为 ChatGPT 赋予记忆功能。

嵌入模型的功能就是把非结构化的文本转换为数值表示的向量,这样才可计算,这一转换过程称为嵌入(embedding)。对输入进行嵌入通常由 LLM 执行, 这样的模型就是嵌入模型。嵌入模型可针对多种目的进行训练,如基于语义,或情感的分类等,比如通过微调使嵌入模型关注情感倾向,通过向模型展示足够多的语义相似文档, 引导模型向语义分析的方向发展,使用情感数据则向情感分析的方向发展。

训练,微调和引导嵌入模型的方法很多,其中最强大的且应用最广泛的技术是对比学习。

对比学习

对比学习是训练和微调文本嵌入模型的一种主要技术。对比学习的目标是训练嵌入模型,使相似文档在向量空间中距离更近,而不相似文档相距更远。 对比学习的基本理念是,向模型输入相似的和不相似的文档对作为示例,这是学习文档之间的相似性或差异性并构建相关模型的最佳方式。

Read More

第九章:多模态 LLM

本书第二部分(使用预训练模型)除了 "文本分类","文本聚类和主题建模" 两章外,其他的 "提示词工程", "高级文本生成技术与工具","语义搜索与 RAG" 这三章都只是对原有知识的巩固. 现在学习本部分的最后一章 "多模态 LLM" 应该能了解到一些模型处理图片的相关知识, 这对我来说是新的知识。

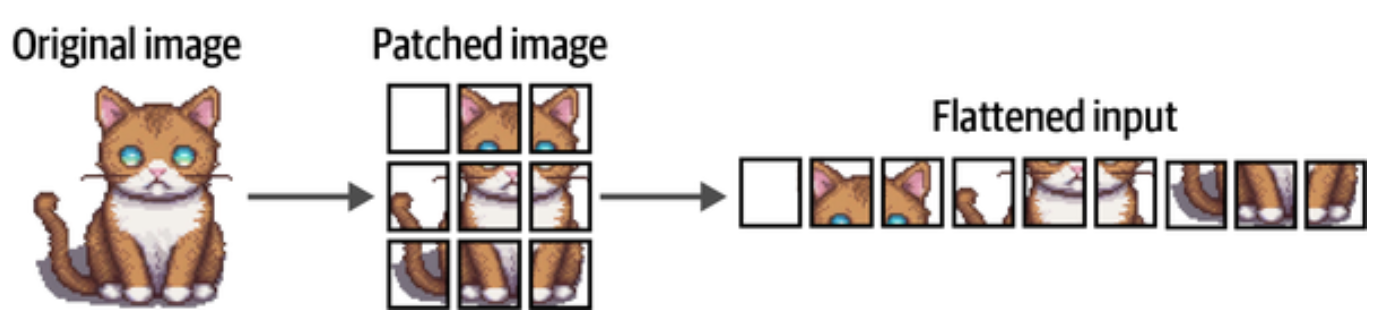

多模态就是指模型能够处理多种类型的数据,比如文本、图像、音频等,而不仅仅是文本,如果你的模型只能处理图像和音频也是多模态。视觉 Transformer (Vision Transformer, ViT) 在图像识别任务中超越了传统的卷积神经网络(CNN)。ViT 的核心功能是将非结构化的图像数据转换为可用于分类等任务的数值表示。

对于文本,Transformer 编码器对文本拆分再编码成数值表示,对文本的切割看成是一维的,ViT 对图像按水平方向和垂直方向进行网格化切割成小块,这和 CNN 用卷积核来提取图像特征的方式类似。

文本的词汇量是有限的,所以可以把文本分割的 Token 映射为一个数值,切成的图片块太过多样性,无法为每一种可能的图片块分配一个 Token. Transformer 的做法是把图片块平铺后对所有图像块实施线性嵌入操作,像文本嵌入一样把一组图片块转换为嵌入向量。这些蕴含语义信息的向量便可作为 Transformer 模型的标准化输入。

Read More

第八章:语义搜索与 RAG

在 BERT 之前 Google 只是关键词搜索,当你把程序的出错信息(特别是带有本地文件路径)往 Google 一贴,什么也搜索不出来,此时就能体现低级和高级程序员的不同水平。 现在形势不同,自从一篇 BERT 的论文(Pre-Training of Deep Bidirectional Transformers for Language Understanding) 发表(2018年) 数月后, Google 把

BERT整合进它的搜索引擎中,特别是加上各种 AI 工具,从此程序员不用再为出错信息而交流了。这就是语义搜索(semantic search)的威力.很早就听说过

RAG(Retrieval-Augmented Generation) 已过时的论调,然而实际学习 AI 时总也避不开RAG. 因为微调模型的少, 再加上模型的上下文窗口太小, 所以有了RAG, 持RAG过时之说大概是因为模型支持的上下文不断增大,原本以RAG片段作为提示词一部分的内容可以全部塞进上下文窗口中, 但对于长短期记忆和大量的资料库的检索,RAG仍然有其存在的价值。语义搜索和 RAG 是否也可以集成到 Lucene, Solr, Elasticsearch 等搜索引擎中,以提升搜索的准确性和效率呢?

语义搜索的几个概念和通常做法

- 稠密搜索(dense retrieval): 从向量数据库中搜索与当前文本向量相似的一些文档,比如 10 个文档. 稠密搜索就是粗泛的大面积快速搜索。

- 重排序(reranking): 对稠密搜索结果重排序(更精细的比较相似度),比如取前 3 个文档. 稠密搜索筛选,重排序进行精选,重排序也可让 LLM 介入. 有一个相关的论文 Multi-Stage Document Ranking with BERT, 常称作 monoBERT 方法

- RAG:通过包括资料分片,向量化存储,对输入向量化后检索相似文档,作为输入提供给 AI 模型,让 AI 基于它们生成结果的全过程

第七章:高级文本生成技术与工具

在上一章中已经从

AutoModelForCausalLM,AutoTokenizer,pipeline过渡到了稍微高那么一层的llama-cpp-python的使用, 这一章将继续学习LLM的使用, 到真正能训练,微调模型还远着呢。 其中大部分的内容都在学习LangChain的过程中有所掌握,包括记忆机制, 智能体工具调用等,所以这方面的内容没有具体展开。本章所覆盖的在不对模型作微调的情况下提升文本生成质量的方法论与技术:

- 模型输入/输出:模型加载与调用, 用 llama-cpp-python 演示

- 记忆机制:增强模型的上下文记忆能力,查看

LangChain短期记忆相关日志 LangChain 核心组件之短期记忆 - 智能体系统:整合外部工具实现复杂行为,用

LangChain1.0 后的create_agent()将会非常简单 - 链式架构:模块化方法与组件的衔接组合, 这是

LangChain0.x 的架构,1.0 后不再使用链式架构

本章进到

LangChain的学习当中,本人对LangChain已经有了一定程度的了解,由于LangChain1.0 于 2025 年 10 月份才正式发布, 显然写作本书的时候用的还是LangChain 0.x的版本,而LangChain1.0 带来了巨大的变化,所以学习当中会把书中的例子改写为LangChain 1.x的版本。下载 llama-cpp 的 GGUF 单文件模型: Phi-3-mini-4k-instruct-q4.gguf

Read More

第六章:提示词工程(Prompt Engineering)

还是继续学习怎么使用生成模型, 这本书也只能涉及到 Prompt Engineering 了, 另外两个高层次的 Content Engineering 和 Harness Engineering 必须找别的资料.

主要为文本生成而训练的模型通常被称为生成式预训练模型(Generative Pre-trained Transformers-GPT), 将要学习如何设计高效的提示词, 了解生成模型, 研究它们的推理, 输出的验证和评估.

由于使用了新的

transformers版本(5.8.0), 以下的代码与书中有所不同1from transformers import pipeline 2 3pipe = pipeline("text-generation", model="microsoft/Phi-3-mini-4k-instruct", trust_remote_code=False) 4messages = [ 5 {"role": "user", "content": "Create a funny joke about chickens."}, 6] 7output = pipe(messages) 8print(output)输出的信息包含

Read Moreuser和assistant两部分, 因为pipeline()有一个默认的参数return_full_text=True(同时返回用户和 LLM 的消息)

第五章:文本聚类与主题建模(Text Clustering and Topic Modeling)

继续巩固 LLM 的基础知识,文本聚类与主题建模是 NLP 中的两个概念,文本聚类就是文本按语义分类,如猫狗一块,苹果西瓜在一起,足球篮球放一堆, 而它们的分类名就是主题了,如动物,水果,体育。主题范围有大有小,水果可以延展到食物,体育可以缩小到球类,语义越相近,就离得越近,这其实就是物以类聚。

可用嵌入模型进行聚类,与文本聚类相关的主题建模方法是 BERTopic. 下面是用 Hugging Face 上的

arxiv_nlp数据集来进行本章的学习,Hugging Face 还真是一个宝藏啊,估计一些禁书都能在里面找到。arxiv_nlp包含了 1991 年到 2024 年来自 ArXiv cs.CL(计算与语言)板块 44949 篇摘要。1from datasets import load_dataset 2dataset = load_dataset("maartengr/arxiv_nlp")得到的 dataset 是

Read More